- 欢迎使用超级蜘蛛池(CJZZC)网站外链优化,收藏快捷键 CTRL + D

影响网站百度蜘蛛抓取量的因素有哪些?

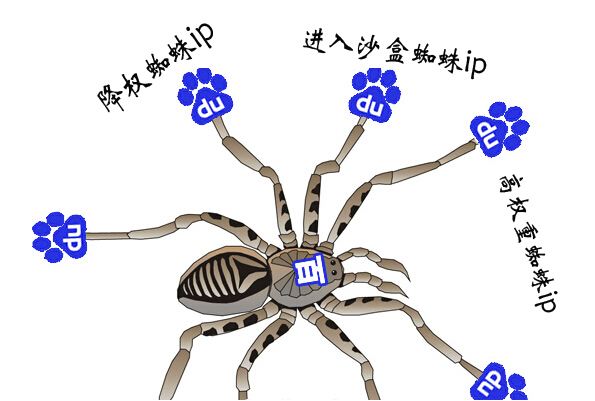

百度蜘蛛抓取量,顾名思义就是指百度蜘蛛每天抓取大家网站的网页数量。据所知,百度蜘蛛抓取的目标有两种:一是这个站点产生的新网页,另一种是百度以前抓取过但是需要更新的网页。

如果不是很好理解的话,这里为大家举例说明下:

比如一个站点已经被百度收录了2w,那么百度会给出一个时间段,比如15天,然后平均一下,每天到这个站点上面抓2W/15的这样一个数字,当然具体的数字肯定不是这个,这个就是百度内部的数据了。

下面具体为大家介绍下影响网站百度蜘蛛抓取量的因素。

1、站点安全

对于中小型站点,由于在安全技意识上比较欠缺, 技术上也比较薄弱,因此网站被黑被篡改的现象非常常见。一般被黑有常见几种情况,一种是网站域名被黑,一种是标题被篡改,还有一种是在页面里面加了很多的黑链。 对于一般网站来说,域名被黑被劫持,就是域名被进行设置了301跳转,跳转到指定的垃圾网站。而这种跳转被百度发现了的话,那么对于你站点的抓取就会降低,甚至于被惩罚降权。

2、内容质量

另外网站内容的质量也是很重要的,如果蜘蛛抓取了我们网站10万条内容,最后只有100条或者更少的内容被建库了,那么百度蜘蛛对于网站的抓取量还会下降。因为百度会认为我们的站点质量很差,没必要去抓取更多。 所以特别提醒:大家在建站初期的时候就需要注意内容质量,不要采集内容,这对于网站的发展来说存在潜在的隐患。

3、站点响应速度

①网页的大小会影响抓取,百度建议网页的大小在1M以内,当然类似大的门户网站,如新浪另说。

②代码质量、机器的性能及带宽。这些都会影响到抓取的质量。代码质量不用多说,蜘蛛本身也属于按照程序执行,你的代码质量很差,很难读懂,蜘蛛自然不会浪费时间去解读。 机器性能和带宽同样如此,服务器配置太差,带宽不够会导致蜘蛛抓取网站出现困难,会严重影响蜘蛛抓取的积极性。

4.同ip上面网站的数量

百度抓取都是按照ip进行去抓取的,比如百度规定在一个ip上一天可以抓取了2000w个页面,而在这个站点上有50W个站点,那么平均下来抓取每个站点的数量会分的很少。同时还需要注意看一看同ip上面有没有大站,如果有大站的话,本来就被分得很少的抓取量又会被大站分走不少。